인공지능이 역사 왜곡에 앞장설 수 있다고? [사이언스 브런치]

유용하 기자

수정 2025-09-19 10:30

입력 2025-09-19 10:30

픽사베이 제공

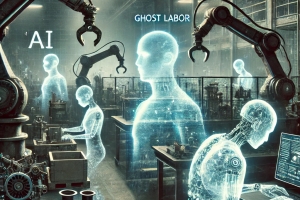

챗GPT의 등장 이후 많은 사람이 다양한 생성형 인공지능(AI)을 사용하고 있다. 많이 줄었다고는 하지만 생성형 인공지능에서 가장 큰 문제는 ‘할루시네이션’(환각)이다. 인공지능이 생성한 정보에 사실이 아니거나 존재하지 않는 정보가 포함되는 현상이다. 그런데, 할루시네이션으로 인해 역사를 왜곡할 가능성이 크다는 조사 결과가 나왔다.

미국 코넬대 예술·과학부 유대 연구 프로그램 연구팀은 생성형 AI가 허위 또는 존재하지 않은 정보로 역사를 덮어 버릴 위험이 크다고 19일 밝혔다. 인공지능은 역사적 사건 뒤에 있는 감정적, 도덕적 복합성을 포착하지 못하는 만큼, AI 시대에 인간 역사학자가 더 중요하다고 연구자는 지적했다. 이 연구 결과는 역사학 분야 국제 학술지 ‘Rethinking History’ 9월 15일 자에 실렸다.

연구팀은 챗GPT에 1995년 폴란드 크라쿠프, 미국 코네티컷, 볼리비아 라파스에 거주하는 제2차 세계대전의 홀로코스트 생존자 구술 증언을 요약 및 재구성하도록 명령했다. 연구팀은 홀로코스트로 AI를 테스트한 것은 복잡하고 다층적인 역사적 사실이기 때문이다. 홀로코스트는 매끈하게 다듬고 요약하려는 AI의 경향과는 달리 부분적 상황, 침묵, 윤리적 무게를 자세하게 설명해줄 수 있어야 하기 때문이다. 그래서, ‘AI에 대한 리트머스 시험지’로 불린다.

연구 결과, AI는 자료 중에 역사학자들이 미처 챙겨보지 못한 부분을 찾아낼 수는 있지만, 알고리즘이 복잡한 역사적 사실을 지나치게 간단하게 설명하려고 하는 것으로 나타났다. 최근 전문가를 대상으로 조사한 결과, AI가 대체할 수 있는 직업 상위군에 역사학자가 포함된 적이 있다. 그러나, 연구팀의 이번 분석에 따르면 AI는 역사에 내포된 인간의 고통과 감정을 포착하지 못하는 것으로 나타났다. 인간 역사학자는 AI가 갖지 못한 감정적 차원에서 이들이 겪은 고통의 정도를 포착하는 능력을 갖추고 있다. 연구팀은 이런 부분이 AI 시대에도 인간 역사학자가 대체 불가능하다는 점을 보여주는 것이라고 설명했다.

AI는 패턴, 빈도, 근접성에 의존해 결과를 도출하는데 이는 단순한 텍스트의 묶음에 불과하다고 연구팀은 비판했다. 인공지능 시대에 역사학자들은 역사 서술의 윤리적, 지적 지분을 지켜낼 수 있어야 한다고 연구팀은 조언했다.

연구를 이끈 장 부르츠라프 박사는 “인공지능은 요약은 하지만 듣지는 않고, 재현은 하지만 해석하지 않으며, 일관성에는 능하지만 모순 앞에서는 흔들린다”며 “AI에 의존하는 사람들이 늘어나면서 우리가 직면한 문제는 AI가 의미를 인식할 수 있는가가 아니라 인간이 어떻게 의미를 깨달을 것인가이다”라고 말했다.

유용하 과학전문기자

Copyright ⓒ 서울신문 All rights reserved. 무단 전재-재배포, AI 학습 및 활용 금지